Однако имя модели не гарант достоверности. Да, в подавляющем количестве случаев это верная информация, на которую можно опираться. Но самый достоверный источник — config.json модели.

Разбор config.json: на что смотреть

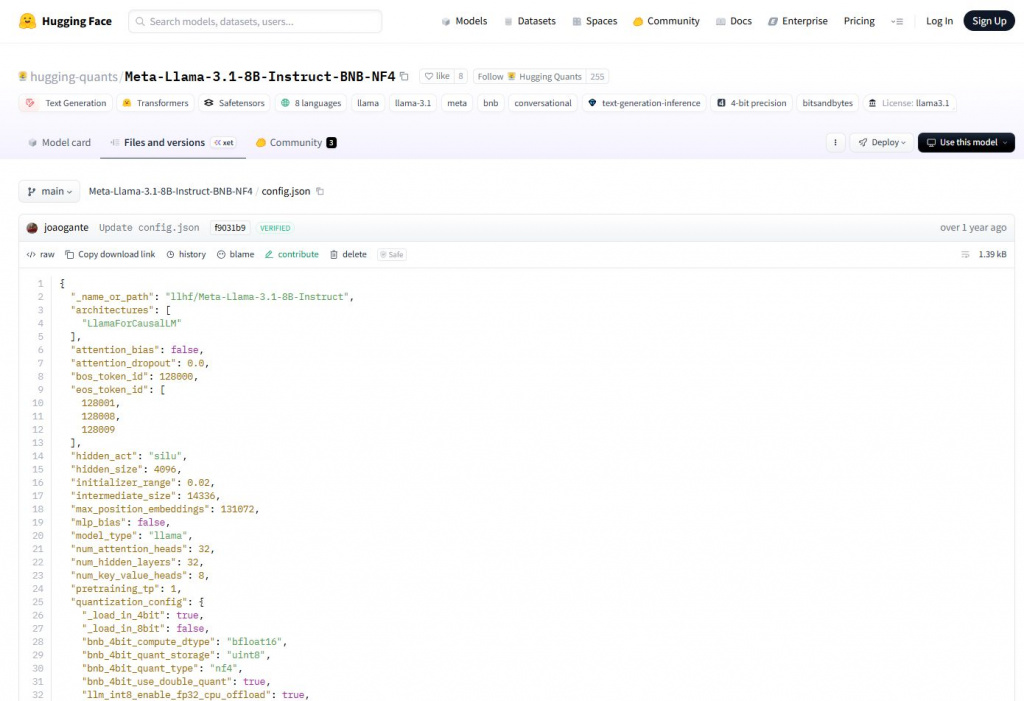

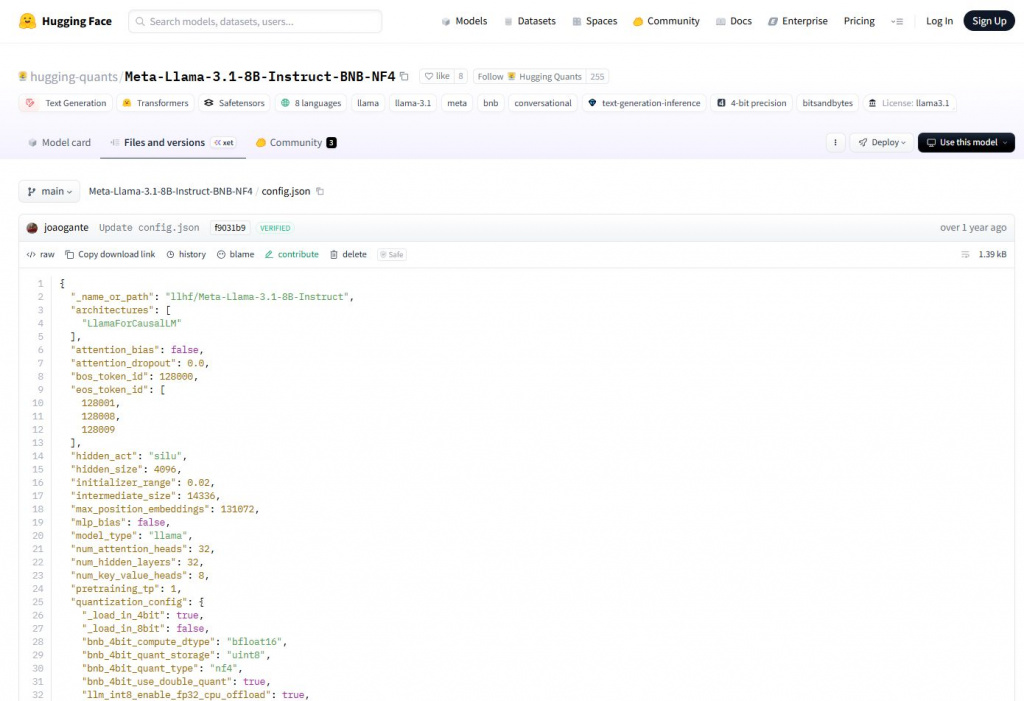

Самая надёжная информация о формате квантизации кроется внутри config.json. На Hugging Face каждая модель имеет этот файл, кроме моделей в формате .gguf. В них информация о квантовании уже встроена в сам файл. У остальных же внутри есть блок quantization_config, который однозначно указывает, как модель была сжата. Вот пример:

"quantization_config": {

"_load_in_4bit": true,

"_load_in_8bit": false,

"bnb_4bit_compute_dtype": "bfloat16",

"bnb_4bit_quant_storage": "uint8",

"bnb_4bit_quant_type": "nf4",

"bnb_4bit_use_double_quant": true,

"llm_int8_enable_fp32_cpu_offload": false

}

Расшифровка ключевых полей:

- _load_in_4bit: true — модель будет загружена в 4-bit формате. Это главный флаг, определяющий режим работы.

- bnb_4bit_quant_type: "nf4" — тип квантизации весов, здесь это NF4 (Normal Float 4-bit), специально разработанный BitsAndBytes для оптимальной компрессии.

- bnb_4bit_compute_dtype: "bfloat16" — вычисления и активации проходят в BF16. Это означает, что при forward pass данные преобразуются в 16-bit, чтобы избежать численных ошибок.

- bnb_4bit_use_double_quant: true — включена двойная квантизация: сами веса квантизованы, плюс квантизованы коэффициенты масштабирования. Это повышает стабильность, но добавляет небольшие вычислительные затраты.

Так выглядит config.json, его можно открыть и посмотреть непосредственно в Hugging Face.

Разобрав подобный конфиг — вы уже точно будете знать, что эту модель нужно загружать через BitsAndBytes runtime. Это не GGUF, это не TensorRT, это именно BNB. Способность читать конфиги и понимать приписки убережет вас от проблем с несовместимостью.

Практические примеры с Hugging Face

Давайте скрепим новоприобретённые знания практикой и разберём названия нескольких реальных моделей с Hugging Face:

- Qwen3-Next-80B-A3B-Instruct-MXFP4.gguf – это модель в GGUF-формате (для llama.cpp), сжатая с помощью MXFP4 (microscaling FP4), это смешанный 4-битный floating-point формат с блочной масштабизацией. При использовании llama.cpp проверьте, что ваша сборка поддерживает FP4, так как это экспериментальный формат на момент 2025 года, его поддерживают самые современные ускорители (B200/B300, MI355X). MXFP4 обещает кратное ускорение относительно FP16 в некоторых операциях, но требует новых GPU (Blackwell, MI355X) для полной поддержки.

- Qwen3-Next-80B-A3B-Instruct-Q4_K_M.gguf – это модель с GPTQ-подобной 4-bit квантизацией, конкретный вариант Q4_K_M означает 4-бит с k-квантизацией и средним вариантом пакования в уже знакомом GGUF-формате. Веса хранятся в 4 битах, но вычисления идут в FP16, что обеспечивает хороший баланс скорости и качества.

- Qwen3-Next-80B-A3B-Instruct-f16.gguf – модель без сжатия, в формате FP16 (16-битный floating-point). Это "эталонный" вариант, который даст вам максимальное качество, но потребует больше памяти. Используйте её, если у вас есть достаточно видеопамяти (для 80B нужно примерно 160 ГБ VRAM в FP16) или если вам нужна максимальная точность.

- Qwen3-Next-80B-A3B-Instruct-int4-mixed-AutoRound – модель, сжатая с помощью AutoRound (метод от Intel), использующий INT4 с адаптивной оптимизацией параметров квантизации. AutoRound показывает двухкратное улучшение в точности относительно других INT4-методов на низких битах. Загружается через Transformers с поддержкой AutoRound или через специальный рантайм SGLang.

- Meta-Llama-3.1-8B-Instruct-BNB-NF4* – это модель Llama* от Meta*, сжатая методом BitsAndBytes NF4. Загружайте её через HuggingFace Transformers с BitsAndBytesConfig. Вычисления по умолчанию идут в BF16. Это отличный выбор, если вы хотите дообучить модель (например с QLoRA) на GPU с 24 ГБ памяти.

- Qwen3-Next-80B-A3B-Instruct-FP8-Dynamic – это модель, подготовленная для FP8 вычислений на современных GPU (H100, MI300, B200, B300). "Dynamic" означает, что масштабирование весов и активаций вычисляется динамически во время инференса, что даёт большую точность, но медленнее статического предварительного масштабирования. Поддерживается в vLLM 0.5+ и TensorRT. На H100 такая модель будет работать в 2x-3x быстрее, чем FP16 вариант, с минимальной потерей качества.

- GLM-4.6-gguf-q2ks-mixed-AutoRound – это экстремальная компрессия: q2ks означает 2-битное сжатие с k-вариантом и стохастическим округлением. Такие модели занимают очень мало памяти, но качество значительно деградирует, и они пригодны только для специфичных задач, где скорость критична. Используйте подобные варианты с осторожностью.

- Llama-3.1-8B-Instruct-q4f16_1-MLC* – модель с q4f16 квантизацией (4-bit веса + FP16 вычисления). Это стандартная комбинация, работает в большинстве рантаймов. MLC в имени указывает на использование MLC Compiler для оптимизации.

Где какие форматы работают (краткая матрица совместимости)

Качество, скорость и стабильность работы напрямую зависят от соответствия форматов весов и активаций выбранной платформе:

Transformers + BitsAndBytes без проблем открывают bnb-4bit и NF4, но требуют особой конфигурации через load_in_4bit=True и корректной загрузки через модуль BitsAndBytes.

GGUF/llama.cpp поддерживает своё семейство квантованных форматов (Q4_K_M, MXFP4, q4f16 и пр.), но BNB веса придётся конвертировать.

TensorRT раскрывает всю мощь FP8/INT8, но не читает привычные GGUF или специфичные реализации BitsAndBytes.

PyTorch vLLM только в свежих релизах начинает работать с FP8, а любые Q4_K_M или AWQ нуждаются в бэкэндах и поддержке на уровне токенизатора и управления памятью.

Поддержка форматов квантизации в фреймворках

| Формат / Тег |

Transformers (PyTorch) |

vLLM |

llama.cpp / gguf |

TensorRT / HW |

| BNB-NF4 / bnb-4bit |

полная поддержка |

загрузка моделей |

требует конвертации |

не поддерживается |

| q4_k_m / GPTQ |

через конвертеры |

частичная |

полная |

не поддерживается |

| w8a8 (INT8) |

через BNB / AWQ |

частичная |

требует конвертации |

TensorRT полная |

| FP8 |

PyTorch 2.5+ |

с H100/MI300 |

не поддерживается |

H100/TensorRT |

| MXFP4 |

экспериментальная |

новые версии |

требует конвертации |

новые GPU (2025+) |

Простая таблица совместимостей форматов квантизации и фреймворков/инструментов.

Если вы используете BNB-NF4 на локальной машине, выбирайте Transformers. Если хотите запустить vLLM для инференса в продакшен, BNB-NF4 даст вам частичную поддержку (модели загружаются, но оптимизация ограничена). Для llama.cpp нужна конвертация в GGUF. В TensorRT BNB-NF4 работает, только если вы используете специальные плагины.

Практические советы

- Всегда проверяйте quantization_config: не полагайтесь только на имя файла. Откройте config.json и убедитесь, что понимаете, какой формат реально используется.

- Для локального инференса используйте llama.cpp с GGUF: это самый стабильный и быстрый вариант для потребительских GPU и CPU. Форматы q4_k_m и q5_k_m показывают лучший баланс скорости и качества.

- Для дообучения на одном GPU используйте BNB-NF4 с QLoRA: это позволяет обучать 13B+ модели на GPU с 24 ГБ памяти. Загружайте через Transformers + BitsAndBytesConfig.

- Для инференса с высокой пропускной способностью используйте FP8 на RTX PRO 6000 Balckwell или AMD Radeon AI PRO R9700: если у вас есть доступ к этому железу, FP8 даст вам двукратное ускорение относительно FP16 с минимальной потерей качества. Используйте vLLM или TensorRT.

- Для edge-устройств используйте INT8 или q4_k_m: если вы разворачиваете нейросеть на мобильном устройстве или Jetson, выбирайте минимально возможное сжатие, которое даёт приемлемое для вас качество.

- Экспериментируйте с MXFP4 осторожно: это новый формат, и поддержка в рантаймах может быть нестабильной. К тому же нативно поддерживается он довольно новыми ускорителями (MI350X, MI355X, H100, H200, B200). Если критична надёжность, придерживайтесь q4_k_m или BNB-NF4 (который поддерживается официально начиная с NVIDIA Pascal и частично AMD ROCm‑GPU).

Заключение

Метки в названиях моделей на Hugging Face – ключ к пониманию, как модель хранится и как она будет работать на вашем оборудовании. Каждый формат представляет компромисс между размером модели, скоростью выполнения и точностью результатов. Правильный выбор сэкономит вам часы отладки и может улучшить пропускную способность инференса в 2-3 раза.

Если вам нужна лучшая практика по квантизации LLM, рекомендуем иные наши материалы: статьи про

GPTQ (практическое квантование),

AWQ (активационно-ориентированное квантование) и подробное

руководство по схемам квантизации. Каждый из этих методов имеет свои сильные стороны в зависимости от того какие цели вы ставите.

Если вы работаете с инференсом на серверах и хотите максимизировать производительность на H100 или MI300, рекомендуем протестировать FP8 – это современный стандарт для высокопроизводительных LLM в 2025 году. ServerFlow предлагает услугу тестирования и оптимизации моделей на современном оборудовании, включая подбор оптимального формата квантизации для вашей архитектуры. Свяжитесь с нами, если вам нужна консультация по развёртыванию.

*LLAMA — проект Meta Platforms Inc.**, деятельность которой в России признана экстремистской и запрещена

**Деятельность Meta Platforms Inc. в России признана экстремистской и запрещена