Обмен данными может происходить на самых разных скоростях, и выбор конкретной цифры зависит от задач, бюджета и архитектуры сети. Сейчас в серверах используются следующие скорости, и каждая занимает свою нишу:

- 1 Гбит/с (1000BASE-T): Ветеран, который до сих пор жив. Используется в потребительских системах, в офисных сетях и в других задачах, где не требуется высокая пропускная способность. Дешево и сердито.

- 10 Гбит/с: Долгое время был золотым стандартом для серверов и сетей хранения данных (iSCSI, NFS). Множество дата-центров среднего уровня до сих пор работают на 10G.

- 25 Гбит/с: Сегодня это основной стандарт для современных дата-центров и облачных провайдеров. Почему не 40? 25G дает лучшую плотность портов и использует более эффективное кодирование, чем 40G (который часто был просто объединением четырех 10G каналов). 25G идеально ложится на шину PCIe, физически полностью совместим с 10 Гбит/с и позволяет эффективно утилизировать ресурсы.

- 40 Гбит/с: Постепенно уходит в прошлое, но еще часто встречается во многих инфраструктурах. Все еще популярен для аплинков и соединения хранилищ данных.

- 100 Гбит/с: Стандарт для ядра сети, для соединения особо жирных серверных конфигураций и для HPC-сектора. Физически совместим с 40 Гбит/с.

- 200 и 400 Гбит/с: Удел гиперскейлеров (Amazon, Google) и самых передовых суперкомпьютеров. Используется для соединения тысяч GPU в кластерах для обучения больших языковых моделей. Там каждый бит на счету.

- 800 Гбит/с и 1,6 Тбит/с: Уже анонсированы производителями. Эти скорости начнут внедряться в ближайшие пару лет для тех же задач ИИ, когда 400G станет недостаточно.

Протоколы передачи данных сетевых карт

Скорость — это, безусловно, очень важна, но не менее важно то, по какому принципу передаются данные. И за эти принципы отвечают сетевые протоколы.

Базой всего, безусловно, является Ethernet и стек протоколов TCP/IP. Это стандарт де-факто, который правит балом везде — от домашнего роутера до облачного дата-центра миллиардного масштаба. Ethernet-карты есть в каждом сервере, и подавляющее большинство трафика в мире идет именно по Ethernet. Но есть и другие, намного более эффективные специализированные протоколы.

InfiniBand — это отдельная вселенная. Когда-то этот стандарт гремел и считался главным конкурентом Ethernet в HPC. Сегодня он сдал позиции в общем сегменте, но остался в нише, где нужны запредельные скорости и, что еще важнее, сверхнизкие задержки. Основной пользователь InfiniBand сегодня — это NVIDIA, которая использует его для соединения своих видеокарт в кластеры (технология NVLink базируется на InfiniBand). В суперкомпьютерах для научных расчетов и обучения ИИ InfiniBand чувствует себя прекрасно, потому что там каждая микросекунда задержки влияет на время завершения задачи.

Fibre Channel (FC) — это протокол для сетей хранения данных (SAN). Он до сих пор жив и неплохо себя чувствует в корпоративном сегменте, особенно там, где есть устаревшее, но надежное оборудование. FC-карты (HBA — Host Bus Adapters) стоят в серверах, подключенных к дорогим дисковым массивам типа Pure Storage или Dell EMC. Однако в малый и средний бизнес Fibre Channel уже не заходит — там правит iSCSI и NFS, которые работают поверх обычного Ethernet.

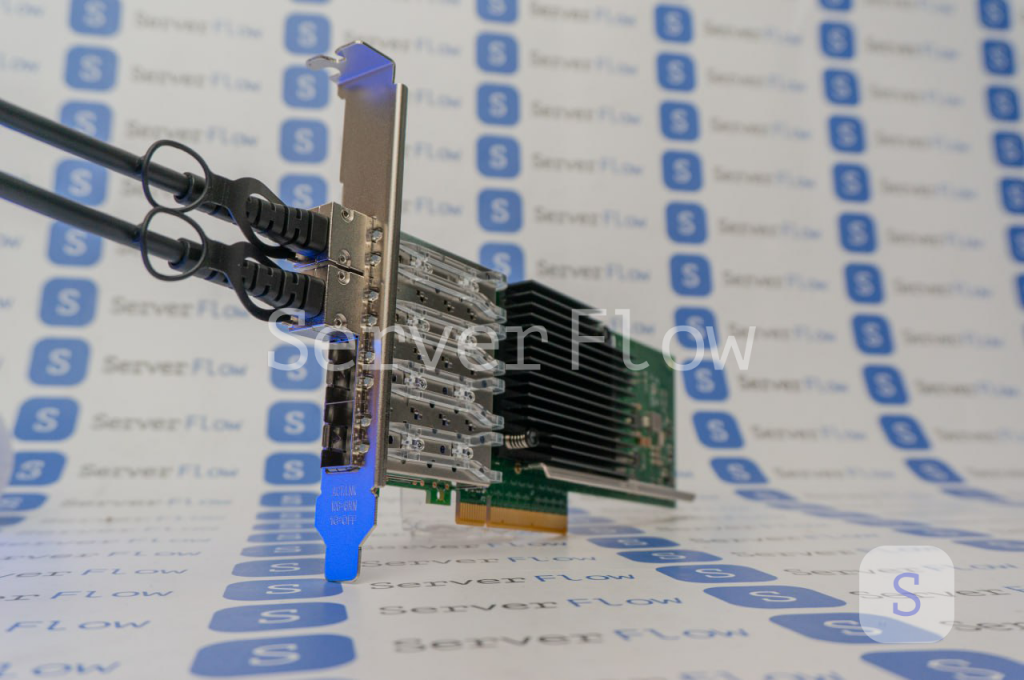

Сравнительно недавно на сцене появился и Ultra Ethernet. Это инициатива одноименной группы компаний (AMD, Intel, Cisco, Microsoft), которая хочет создать открытый стандарт, способный конкурировать с InfiniBand в задачах ИИ и HPC. Идея в том, чтобы не зависеть от проприетарных решений NVIDIA и развивать Ethernet в сторону сверхнизких задержек и улучшенного управления перегрузками.

Нельзя не упомянуть и нишевые разработки вроде Intel Omni-Path, архитектуры Slingshot от Hewlett Packard Enterprise (используется в суперкомпьютере Frontier) или решений от Solarflare (теперь часть Xilinx/AMD), которые славились своей способностью обрабатывать огромные биржевые потоки и данных в HPC-кластерах с минимальной задержкой. Другими словами, тема сетей превратилась в настоящую гонку кластерных вооружений. Современный бизнес все больше зависит от распределенных вычислений, а значит, все висит на сетях.